Autocompletar de Google: ¿Realmente atenta contra tu privacidad?

AEPD abre un nuevo frente contra Google: estima oposición al autocompletado.

Estamos ante la primera resolución publicada en la web de la Agencia Española de Protección de Datos, al menos que conozcamos, en las cuales se estima el derecho de oposición frente a la llamada función de autocompletado que ofrece Google (Google Suggest®) en sus búsquedas. De manera, que podemos afirmar, que en la cruzada iniciada por nuestra Autoridad de Protección de Datos contra Google ya hace tiempo, se sube un peldaño más.

¿Qué solicita el afectado?

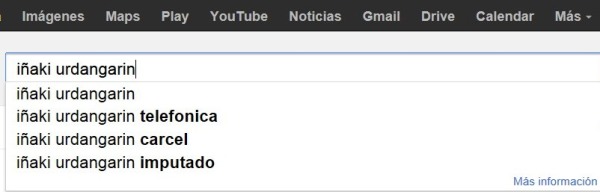

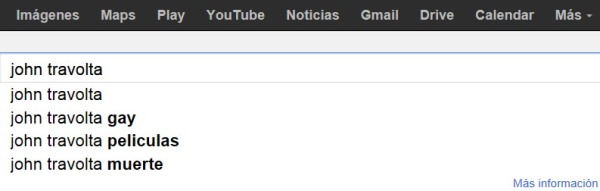

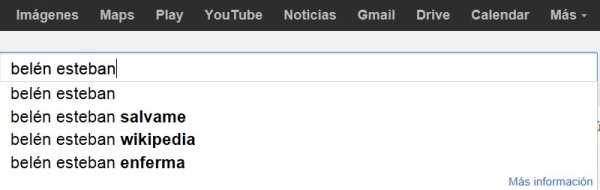

Un ciudadano denuncia a Google Spain (Google INC) –ojo que así aparecen citadas en el encabezamiento de la resolución y no son lo mismo, una es la que podemos llamar la filial en España y la otra la matriz americana- que cuando introduce su nombre y apellidos en el apartado de búsqueda se le asocia automáticamente a “gay”. Seguramente, muchos de nuestros ávidos lectores se habrán dado cuenta de que al buscar a una persona en numerosas ocasiones se le añaden calificativos de lo más variopinto.

Veamos algunos ejemplos:

Esta persona dirige su solicitud a Google INC –ojo y no a Google Spain- y al no ser atendida en plazo presenta ante la Agencia reclamación de tutela del derecho de oposición.

Google alega (aquí la resolución no especifica si es INC o Spain quien alega).

Gran parte de ellas, ya son de sobra conocidas puesto que han sido empleadas en otros procedimientos (cancelación u oposición de datos publicados en Internet): “ley aplicable” -cuestionando por tanto la aplicación de la normativa europea y/o española sobre protección de datos- y “diferenciación de persona jurídica” entre la matriz (Google INC) y la filial, así como que su negocio es diferente (de este tema ya hemos hablado en alguna ocasión por estos lares).

Y por fin llegamos a lo que interesa a los efectos de esta resolución, obviamente, la descripción de cómo actúa la función de autocompletado:

Google Inc. en su página web informa de que cuando un usuario teclea los términos de una consulta en el cuadro de búsqueda del buscador, el algoritmo de la función Autocompletar predice los términos de búsqueda que el usuario podría estar introduciendo para que el usuario pueda seleccionar entre las diferentes propuestas y así, facilitar su búsqueda. Para determinar dichas predicciones, se usa un procedimiento basado en algoritmos sin intervención manual. Google Inc. declara que es evidente que aunque los términos de búsqueda introducidos por el usuario puedan coincidir con el nombre de una persona, ni esos términos, ni ningún otro que la función Autocompletar pueda mostrar junto a ellos pueden considerarse “información concerniente” a esa persona. Se trata de “una mera yuxtaposición de términos de búsqueda que la estadística indica que con cierta frecuencia aparecen juntos, sin que se pueda establecer una relación semántica entre ellos, sin que, ni mucho menos, unos proporcionen información sobre los otros, y sin que pueda decirse que constituyen información acerca de una persona”. Los usuarios no deben interpretar en ningún caso que los términos que se muestran en la función Autocompletar sean afirmaciones, ya que es evidente que esos términos se generan de forma automática y pueden referirse a contextos muy variados y tener significados muy diversos.

La única función del algoritmo es hallar las combinaciones de términos similares a los que el usuario pretende introducir. La utilidad es evidente: como es frecuente que cualquier búsqueda que un usuario quiera realizar sea similar a otras anteriores, mostrarle esas combinaciones, a menudo facilita la búsqueda que el usuario va a introducir.

Ello no significa, sin embargo, que los términos de búsqueda introducidos por un usuario, o los que Autocompletar pueda mostrar en sus predicciones, tengan que coincidir con el contenido de ninguna página web concreta, o con los resultados de la búsqueda. Simplemente indican que esos términos de búsqueda han sido introducidos previamente, pero eso no prejuzga el resultado. Como bien señala el propio interesado en su solicitud, aunque al teclear los términos de búsqueda “A B.B.B.”+” A.A.A.”, Autocompletar pudiera mostrar como posibles términos de búsqueda “ A.A.A.”+”Gay”, de ello no se deduce que exista ninguna página web en la que se identifique a ninguna persona con ese nombre como homosexual (que no consta que la haya). Tampoco significa que las búsquedas realizadas por otros usuarios tuvieran esa connotación.

En cualquier caso, lo que resulta claro es que la función Autocompletar no proporciona información acerca del solicitante, ni establece ninguna vinculación entre los términos “B.B.B.” y “gay”. De hecho, las predicciones que pueda mostrar la función Autocompletar no son oraciones, ni tienen en sí mismas significado necesariamente. No se trata de afirmaciones, ni de imputaciones de hechos, calificaciones o valoraciones. O esto es lo que defiende Google.

A primera vista, nosotros, podemos concluir que no se entiende absolutamente nada. No sabemos si está hecho farragosamente a posta, si se quiere decir estrictamente lo necesario; o bien, si es lo que hay. La palma se la lleva la frase que comienza con “Se trata de una mera yuxtaposición de términos de búsqueda que la estadística indica que con cierta frecuencia aparecen juntos…”.

De un segundo intento -realmente exige varias lecturas- destacamos que otro de los criterios que Google emplea en su algoritmo –tal y como indica en la página que estamos comentando- es “el contenido de las páginas web que Google indexe”

Por ello, decidimos recabar la opinión de alguien “neutral”, es decir que no tenga una especial simpatía por ninguna de las partes en litigio, y que pueda conocer algo más cómo funciona ese “G-invento”, y acudimos a nuestro amigo Oscar Martín Herrera, experto en SEO y SEM que dirige Mutantia Planet Networking y le planteamos la siguiente cuestión: ¿Hasta qué punto consideras que pueden o podrían influir las meta-etiquetas de las webs en el contenido del algoritmo de Autocompletar? Parece que si Google o incorpora en la información que ofrece al usuario pudiendo no ponerlo, por algo será, ¿no? Oscar, muy amablemente, recogió el guante y nos contestó con lo que sigue:

“Google cada vez tiene más datos sobre nosotros y sobre lo que buscamos en internet.

La función de autocompletado o “Google Suggest®” es una función muy interesante para los que nos dedicamos a estudiar posicionamiento en buscadores, ya que si estás posicionado por una determinada frase y esa frase se la sugiere Google a sus usuarios, esto conlleva un volumen más alto de visitas.

La función autocompletar no nos muestra los mismos resultados a todos, intervienen factores individuales (mi propio historial de navegación) y otros factores como:

– Volumen de búsquedas: Es el factor más obvio, a mayor volumen de búsquedas por usuarios únicos, más probable es que Google use dicha búsqueda en la función de autocompletar. Google cada vez usa métodos más sofisticados para determinar que las búsquedas realmente están realizadas por usuarios únicos. Esto se debe a que muchas empresas de posicionamiento están intentando influir en esta función por el gran poder que conlleva.

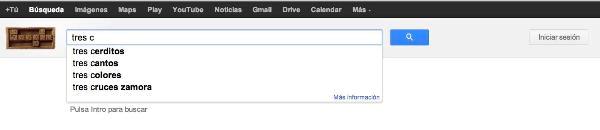

– Geolocalización y dispositivo: La función de autocompletar usa nuestra ubicación para proporcionarnos los datos más afines a nuestra localización y a nuestro dispositivo. Google en los últimos tiempos ha hecho un gran avance en hacer sus resultados de búsqueda más contextuales y relevantes, es decir mostrarte los resultados dependiendo de tus necesidades particulares. En la siguiente imagen se puede ver como al escribir: “tres c” Google me sugiere en cuarta posición “tres cruces zamora”; esto es debido a que estoy realizando la búsqueda desde Zamora, lo cual no significa ni mucho menos que sea lo más buscado por esas palabras en toda España…

– Keywords usadas en contenido reciente: Google le da mucha relevancia a lo que pasa en cada momento, por lo que también usa el contenido “fresco” para dicha función, en especial contenido de noticias y de actualidad.

– Keywords usadas en contenido reciente: Google le da mucha relevancia a lo que pasa en cada momento, por lo que también usa el contenido “fresco” para dicha función, en especial contenido de noticias y de actualidad.

En mi opinión, y como conclusión personal, Google usa toda la tecnología a su alcance para ser más relevante, en el caso concreto de la función autocompletar no se limita al número de búsquedas absolutas de una determinada palabra o frase sino que lo pone en contexto de la persona que realiza la búsqueda.

Parece pues, que efectivamente, los criterios que Google emplea en su herramienta, podrían ser más complejos de lo que en su información ofrece.

Bien, siguiendo con las alegaciones de Google, en el supuesto que nos ocupa de la función Autocompletar, no se podría hablar de un fichero organizado o accesible con arreglo a criterios determinados en el sentido contenido en la LOPD y en la Directiva, por las siguientes razones:

– En primer lugar, las listas de predicciones de búsquedas que proporciona la función Autocompletar no son estables, pues dependen de diversos factores en evolución, entre otros, las búsquedas de otros usuarios (y otros como los que nos comentaba Oscar). Estas listas de búsquedas evolucionan en función de los intereses siempre cambiantes de los usuarios. Además, las consultas se muestran a petición de un usuario en tiempo real, y desaparecen de la pantalla del usuario tan pronto como éste sale de la página. Por ello, estas consultas sólo se almacenan transitoriamente y se procesan de acuerdo con criterios “estadísticos” que cambian constantemente, que es lo contrario de la estabilidad que parecen requerir para los ficheros de datos personales los artículos 3.b) de la LOPD y 2(c) de la Directiva.

– En segundo lugar, como ya se ha señalado las listas de predicciones de búsquedas no están estructuradas en tomo a los nombres de personas físicas. Por el contrario, son listas de términos muy heterogéneos en las que no se tiene en cuenta si existen datos personales o no. La función no distingue un apellido de un nombre común o de cualquier otro término. Únicamente estaríamos ante un reflejo de los patrones estadísticos de consultas anteriores de usuarios del servicio con independencia del tipo de información objeto de sus búsquedas.

– En tercer lugar, como se ha señalado previamente estas listas no obedecen a ninguna finalidad específica relacionada con el uso de los datos personales, ya que se muestran en función de factores objetivos, como las consultas realizadas por otros usuarios.

Por su parte, la AEPD, ya en los fundamentos de derecho, tras hacer un recorrido por la regulación del derecho de oposición, aplicación de la LOPD y Directiva Comunitaria de protección de datos (ley aplicable) así como la diferenciación entre la aplicación a la sucursal (Google Spain) de los actos de la matriz (Google INC), responde a las alegaciones resumidas anteriormente, y referidas a la función de autocompletar, empleando la siguiente argumentación:

Al introducir nombre y apellidos de una persona (obviamente, información de carácter personal) la herramienta de Google, ofrece la asociación de tal información con el apelativo ya varias veces mencionado y ello implica la existencia de una información concreta relacionada con la persona a la que se refieren los nombres y apellidos; es decir, nos encontramos ante datos de carácter personal. Al asociar los datos personales buscados con el adjetivo sugerido por Google, tal atributo se convierte en una información directamente relacionada con la persona identificada del solicitante de la tutela.

Además, en este caso, para la Agencia, el término sugerido por el buscador, implica la asociación del interesado con un dato referente a su vida sexual, que tiene la condición de especialmente protegido, conforme al artículo 7.3 de la LOPD.

La asociación de la identificación de una persona con determinada información aparentemente referida a la misma, en aplicación del concepto sumamente amplio de tratamiento establecido tanto por la normativa española como por la de la Unión Europea, no cabe duda de que debe ser considerada como un tratamiento de datos de carácter personal.

Para la Agencia, resulta irrelevante la no existencia de intervención humana al efecto de determinar si lo que hace “Autocompletar” es o no un tratamiento de datos.

Y además “pone en juego” el artículo 13.1 de la LOPD que dispone que “los ciudadanos tienen derecho a no verse sometidos a una decisión con efectos jurídicos, sobre ellos o que les afecte de manera significativa, que se base únicamente en un tratamiento de datos destinados a evaluar determinados aspectos de su personalidad”.

Por tanto para la Agencia, está claro que existe un tratamiento y por ello será de plena aplicación la Directiva (artículo 3.1).

Y para colmo, Google reconoce que puede intervenir en ese proceso que pregona como totalmente automatizado, puesto que reconoce que “aplican un conjunto de políticas para eliminar contenido pornográfico, violento o de incitación al odio, así como ciertos términos que se suelen utilizar para la búsqueda de contenido que infringe derechos de autor (…) Intentamos ofrecerte consultas de búsqueda relevantes, pero excluimos un grupo limitado de resultados relacionados con contenido infractor de derechos de autor, de incitación al odio, violento o pornográfico.”

En resumen, para la Agencia, existe tratamiento de datos personales, se realizan perfiles (se hace alusión a la impugnación de valoraciones del artículo 13 de la LOPD) y además, independientemente de que la función se realice de forma mecánica o no, existe la posibilidad de modificar lo que aparece al usar esta función, ya que así lo señala la política de funcionamiento de esta herramienta.

Nuestra opinión.

Llama la atención este asunto, puesto que hasta la fecha, que sepamos, podemos estar ante el primer caso existente de esta índole, ya que los planteados con anterioridad se referían a personas jurídicas (Italia, Francia, Argentina). A este respecto, mencionar que la LORTAD en su primera versión contenía la aplicación de la misma a las personas jurídicas. ¿Se imaginan si tal aplicación fuese real lo que nos podríamos encontrar sobre determinadas empresas?

Dejando de lado el problema de ley aplicable, ya que este post no va sobre eso, debemos discernir en primer lugar si estamos ante un tratamiento de datos de carácter personal.

El hecho de que exista o no tratamiento de datos personales, como es obvio, determinará si es de aplicación la normativa de protección de datos. Pero aún en caso negativo, tampoco estaríamos ante la indefensión del sujeto en cuestión, puesto que podría valorarse la aplicación de la Ley Orgánica 1/1982, de 5 de mayo, de Protección Civil del Derecho al Honor, a la Intimidad Personal y Familiar y a la Propia Imagen.

Ciertamente, y como alega Google (como ya hemos dicho, se cita así tal cual en esa parte de la resolución), la función de autocompletar recoge términos que no necesariamente son información de carácter personal, aunque también los recoja de este tipo.

De manera que desde nuestro punto de vista, atendiendo a la definición que da la LOPD, dicha función representa un tratamiento de datos de carácter personal.

En este sentido, como ya hemos dicho, para determinar la aplicación de la normativa, las Autoridades de Control parten de la existencia o no de tratamiento y/o fichero. Y para ello, acuden al concepto de “estructurado”, es decir la existencia o no de criterios que permitan una “búsqueda fácil”. Sirva como ejemplo la Sentencia del Tribunal Supremo sobre los libros bautismales “no automatizados” a losque no otorgan esa consideración porque no permiten acceso fácil a los datos que contienen y por tanto no pueden ser considerados un conjunto estructurado de datos. Y ello lleva a considerar que a la solicitud de cancelación de los datos de tales libros no le es de aplicación la LOPD, pese a tratarse de un tema que claramente afecta a datos personales[i].

En el presente caso, no es que el acceso sea fácil sino que parece sencillísimo: basta con introducir el nombre y apellidos de alguna persona para que te ofrezcan “calificativos” sobre la misma.

Respecto a que no existe intervención humana, como bien dice la AEPD, resulta indiferente. De aceptar esta alegación, la mayoría de operaciones del llamado “Big Data” quedarían fuera de la aplicación de la normativa de protección de datos (ojo, siempre y cuando se usen datos personales y no una disociación irreversible), pero es que además, en su política de funcionamiento, Google, en nuestra opinión, se “pilla los dedos” al anunciar que puede modificar lo que aparezca (vulneraciones de derechos de autor, incitación al odio, contenidos violentos o pornográficos…). De hecho, podríamos preguntarnos la razón por la cual Google se limita sólo a contemplar este tipo de supuestos: ¿es que acaso los derechos de autor son más importantes que la privacidad de un sujeto?

Una alegación que podría haber prosperado, si es que el sistema de autocompletado contemplase las meta-etiquetas incluidas en los códigos de las páginas web, sería que fuese el propietario o editor de la web el que tuviese que eliminar las mismas. En otras palabras, sin meta-etiquetas que calificasen a uno como “gay”, autocompletar no ofrecería sugerencias de esa persona como “gay”. Sería un caso similar a los Boletines: son éstos los responsables y no los buscadores que se limitan a indexar lo que aquellos publican (olvidándonos de los “índices persistentes” una vez que el boletín hubiese eliminado el contenido original). Sin embargo, en las alegaciones del buscador así como en la política de funcionamiento de esta herramienta, indican que “Google Suggest®” ofrece los resultados en función de las búsquedas que realizan los usuarios. Podríamos pensar por tanto en que son ellos los que incluyen las palabras de búsqueda por lo que la responsabilidad sería en este caso sólo suya”. Pero desde luego, el que guarda y administra estas búsquedas es Google. Y por ello, nos viene a la cabeza otra reflexión: cuando el usuario le comunica que para él lo que ofrece Google en sus sugerencias no es lícito, ¿no está transmitiendo “conocimiento efectivo” a un prestador de servicios de la sociedad de la información y éste debería adoptar la diligencia debida y retirar o bloquear dichos contenidos –las sugerencias en este caso-?

Otra reflexión que nos viene a la cabeza con todo este asunto es que de aplicar “Privacidad por diseño” quizá gran parte de este tipo de situaciones, ni se llegarían a producir. O sí… Es decir, pensemos en que una vez que el particular ha hecho la búsqueda y Google recopila esa información para ofrecer este servicio, determinadas palabras fuesen bloqueadas por el propio buscador. Seguramente este enfoque también podría ser criticado por algunos y habría quien reclamaría “su derecho” a que dichos términos se incluyeran. Alegarían seguramente, que se estaría limitando la libertad de información… Como vemos, resulta excesivamente subjetivo y por esto, en nuestra opinión, debería ser el propio particular que estime que se está vulnerando su privacidad el que se dirigiera al buscador para eliminar lo que ofrezca esa función de autocompletado, y no al revés, y por supuesto, el buscador, puesto que reconoce poder intervenir sobre los resultados que esa función ofrece, debería respetar -sin dilación ni excusa alguna- los deseos del particular cuando estos estén perfectamente fundados. Cada caso debería ser analizado individualmente, lo mismo que ocurre –en nuestra opinión- ante el “Derecho al Olvido”.

Por último, nos resulta muy llamativa la aplicación que hace la AEPD del artículo 13 de la LOPD que regula la impugnación de valoraciones. Hasta la fecha ese precepto había sido utilizado, sobre todo, en cuestiones de solvencia patrimonial. De manera que la Agencia viene a determinar que Google realiza perfiles…. Habrá que permanecer atento a las pantallas al próximo episodio de esta exitosa serie “La AEPD contra Google…”

Imagen: Big Brother Google is Watching You Poster

[i] J.L. Piñar Mañas “Comentario a la Ley Orgánica de Protección de Datos de Carácter Personal”. Editorial Cívitas

27 de diciembre de 2012 @ 19:37

Felicidades por el post, es más que interesante. La verdad es que ente los unos (AEPD) y los otros (Google) nos traen locos. Si lo he entendido bien: 1. Los términos sugeridos salen de que los usuarios han hecho muchas veces esas combinaciones de búsqueda, por lo que eso solo son palabras, a menos que sean datos identificativos “de primer orden” como un dni, no son información que haya que presumir que identifica a una persona y mucho menos que es veraz. Me resulta difícil en abstracto admitir que sean datos personales los calificativos “sin más”. Si yo pongo mi nombre y sale “murciana” eso no hace que yo sea murciana. Ahora bien, si pongo mi nombre y sale mi teléfono, entonces se muestra un dato personal que no debería estar ahí. 2. Está claro que siempre hay humanos detrás de todo, hasta de Google, si pueden alterar esos términos sugeridos para no mostrar “free download” seguro que puede eliminar otras cosas, estoy de acuerdo que a petición y previa comprobación de que son lesivas. De hecho lo que hacen es censurar su propio motor de búsqueda (tan libre, tan absoluto), pero solo lo que les interesa o les conviene. Pero en cualquier caso, si se afirma que hay dato personal, deben atender al derecho de oposición. 3. Yo creo que este tipo de casos, son más propios del honor que de la privacidad, lo contrario es afirmar que el dato es cierto y por eso se ejerce oposición, no? si no es cierto y por lo tanto es una asociación de datos sin ninguna base, yo usaría el derecho de rectificación, no? o me iría por la via del honor (si es que hay que ir a algún sitio con eso). Cómo lo ves? tiene algún sentido lo que digo o me estoy liando? Un saludo!

27 de diciembre de 2012 @ 20:35

Muy buena entrada. ¡Felicidades Javier!

A parecer el interesado en un primer momento ejercita su derecho de oposición ante Google Spain, S.L. , y tras la respuesta de ésta requiere a Google Inc. Luego la Agencia lo tendría fácil, según su propia y reiterada interpretación le bastaría con referirse siempre a “Google Inc, representada por Google Spain, S.L.” o “Google Spain, S.L., en representación de Google Inc.” (“no se produce error alguno al dirigir el acuerdo de apertura de procedimiento de tutela de derechos a Google Spain como representante en España de Google Inc”), pero a veces parece referirse a ambas indistintamente, y una cosa es ser y otra representar. No obstante, yo entiendo que Google Inc es el responsable y Google Spain, S.L. el representante. Y si no que la AEPD acuñe el término Google SpaInc y “punto pelota”.

A parte de todo lo que indicas en el post, hay un par de cosillas que me llaman la atención:

1.- Que se ejercite derecho de oposición y la AEPD acabe instando a que Google (no sabemos bien si Spain o Inc) “adopte las medidas necesarias que eviten la asociación indebida de los datos … con el término <>”. En mi opinión, lo que subyace es más bien el ejercicio del derecho de rectificación, no de oposición. Me gustaría poder leer la denuncia presentada por el interesado en cuestión, pero al parecer el motivo es que con la función autocompletar “se le asocia a la palabra gay resultándole <>, convirtiéndose en una <>”. Es decir, lo que le molesta a este individuo no es que Google trate sus datos, sino que los asocie a la palabra “gay”. A mí lo que me parece lamentable es que eso le pueda parecer ofensivo a nadie. En todo caso, como digo, lo que aquí parece subyacer más bien es una rectificación, no una oposición, pues según la resolución de la AEPD ¿qué impide a Google asociar el nombre de este señor a la palabra “machote”?

2.- Que esa misma explicación (que le resulte “molesto y ofensivo”) parezca bastar como justificación para ejercer el derecho de oposición, cuando en mi opinión, en este caso, debería fundamentarse en que en la ponderación entre el interés legítimo perseguido por Google y los derechos y libertades fundamentales del interesado, deben primar éstos con motivo en la inexactitud, falta de veracidad de los datos (Art. 4 LOPD) y que la sexualidad es un dato personal de especial protección. No me parece de rigor que, hablando de datos de carácter personal, se tenga que acudir a criterios, más propios a priori del derecho al honor, pues la protección a los datos personales se basta y se sobra por sí sola.

Un saludo.

31 de diciembre de 2012 @ 01:02

Buenas,

Interesante “revisión” del caso del derecho al olvido?

Entiendo que se puede considerar que Google Suggest podría llamarse el “efecto multiplicador del efecto multiplicador” que dice la AEPD que tienen los servicios de Google sobre la privacidad de los sujetos. En realidad, no creo estamos más allá del problema de base. Basta con leer este post para darse cuenta.

Insisto como hice hace ya algún tiempo…

http://www.iurismatica.com/sobre-el-caso-aepd-vs-google-inc-y-el-derecho-a-la-cancelacion/

…en que estamos ante un problema en el que la LSSI ha de jugar un papel fundamental.

Más en concreto, las claves las hemos de tratar de localizar en las exenciones de responsabilidad, en los puertos seguros, que se establecen para los proveedores intermediarios, de modo tal que no existe responsabilidad a priori y mientras no se atienda adecuadamente a eventuales acciones de cesación.

En lo que creo que estamos todos de acuerdo es que estos casos de una dificultad especialísima por cuanto se han de contraponer intereses generales con intereses particulares. Tanto es así que entiendo que una mera solicitud de derecho de cancelación no ha de entenderse como un “conocimiento efectivo” por cuanto que ello trasladaría a Google el papel reservado a los jueces, aunque en este caso con intermediación previa de un organismo regulador, por otra parte con capacidad competencial limitada como para poder decidir considerando todas las aristas del caso (Ley Orgánica 1/1982, LSSI,…)

Rosalía decía que el hecho de que uno se vea ligado al término gay no debiera ser un problema. Quizás pueda no parecerlo, pero se me ocurre quizás ello pudiera tener efecto por ejemplo en la decisión de concesión de la adopción de un hijo o hija a la persona en cuestión donde imagino quienes deciden en estas lides no estarían obviando lo que la vigilancia digital puede traerles para optimizar el screening sobre los solicitantes. Igual ello no pasa aquí, pero igual sí en otro país. No debe olvidarse el hecho de que Google preste un servicio global, o incluso que el caso en cuestión puede llegar a tener una relevancia mundial donde el criterio de la localización del contenido deje de tener tanto peso y donde el algoritmo ofrezca el resultado impugnado cediendo a los designios le marca una relevancia mundial en la búsqueda con respecto a una determinada persona.

En el post se habla del recurso a la privacidad por diseño como una posible opción para evitar que se presenten los nombres de personas asociados a determinados términos. Ojo, pues nunca llueve a gusto de todos y no faltarán quienes reclamaran que en esas autolimitaciones que se hace la propia Google se incluyan los términos gay, lesbiana u homosexual por ejemplo resultar discriminatorios.

Si pudiera ser que la privacidad por diseño, en su modalidad de privacidad por defecto, haya sido algo a tener en cuenta al liberar este servicio. Pensando en eliminar “el efecto multiplicador del efecto multiplicador” Google podría haber decidido ofrecer el servicio de sugerencias sólo a quienes desearan contar con él y lo activaran expresamente (como por ejemplo el Google Safe Search), pero no debiera haber hecho lo mismo con “el efecto multiplicador”? Si Google hubiera aplicado privacidad por defecto en su servicio de búsquedas, esto es, haber incluido una solución que evitara indexar, no ya nombre y apellidos, sino datos personales en general de los resultados, viviríamos hoy en día en la sociedad en que vivimos?

Luego está el asunto del derecho a la impugnación de las valoraciones automáticas sobre personas. Realmente Google está valorando, afirmando que la persona es gay por presentar una sugerencia de búsqueda? Imagino que habréis oído hablar del Google Bombing. Creo que, siendo cierto este derecho va a tener importancia en lo que al respecto de muchos casos de Big Data se refiere, no va a ser relevante en este o en los otros casos del derecho al olvido.

El problema de este y otros casos similares es que la solución que pueda traer la LSSI no acaba por satisfacer a todos. Google se saldría de rositas y la persona que reclamó la retirada del contenido quedará en manos de los administradores de las páginas web que alojen el contenido que les relacione con el término, objeto final de la discordia, que podrían ser una o miles o cientos de miles o… También pudiera ser que la libertad de expresión haya de primar sobre la privacidad en el caso concreto, cuestión sobre la que la AEPD no tiene capacidad de competencia

Pienso que la solución al problema, cuando realmente corresponda la retirada del contenido, está en la propia tecnología empleada en el código de las webs y sus contenidos y en la indexación de los mismos, donde además debería velarse por un sistema en que Google y otros buscadores sirvan de herramienta para expandir la solicitud de retirada del contenido de las páginas web cuando ello proceda dado el volumen al que tendrían que dirigirse los afectados.

Algunos podrían llegar a indicar que con una solución de este tipo pondríamos en peligro la esencia de los servicios de búsqueda e incluso hasta la disponibilidad de la información pudiendo llegarse a parir una herramienta de censura global, pero pienso que la realidad no sería tan catastrófica, pues después de todo los estos casos conflictivos que se dan y se seguirán dando no pasan de ser anecdóticos si los consideramos proporcionalmente con respecto al todo de los tratamientos de datos personales que se producen cada segundo en el buscador. De no ser anecdóticos no creo que Google hubiera llegado nunca a ser lo que es. Ni Internet o la World Wide Web.

Retomando lo dicho en el libro Code de lawrence lessig, y dándole la vuelta a sus conclusiones, me pregunto si al final veremos cómo el código del este (código jurídico) acaba por regular cómo se ha de escribir el código del oeste (código informático).

Por cierto, que para este y otros de los grandes debates jurídicos de Internet recomiendo la lectura o repaso del referido libro. Especialmente interesante el capítulo específicamente dedicado a la privacidad. Un buen libro a tener siempre a mano

Como anécdota recordar que el libro es de 1999 ;-p